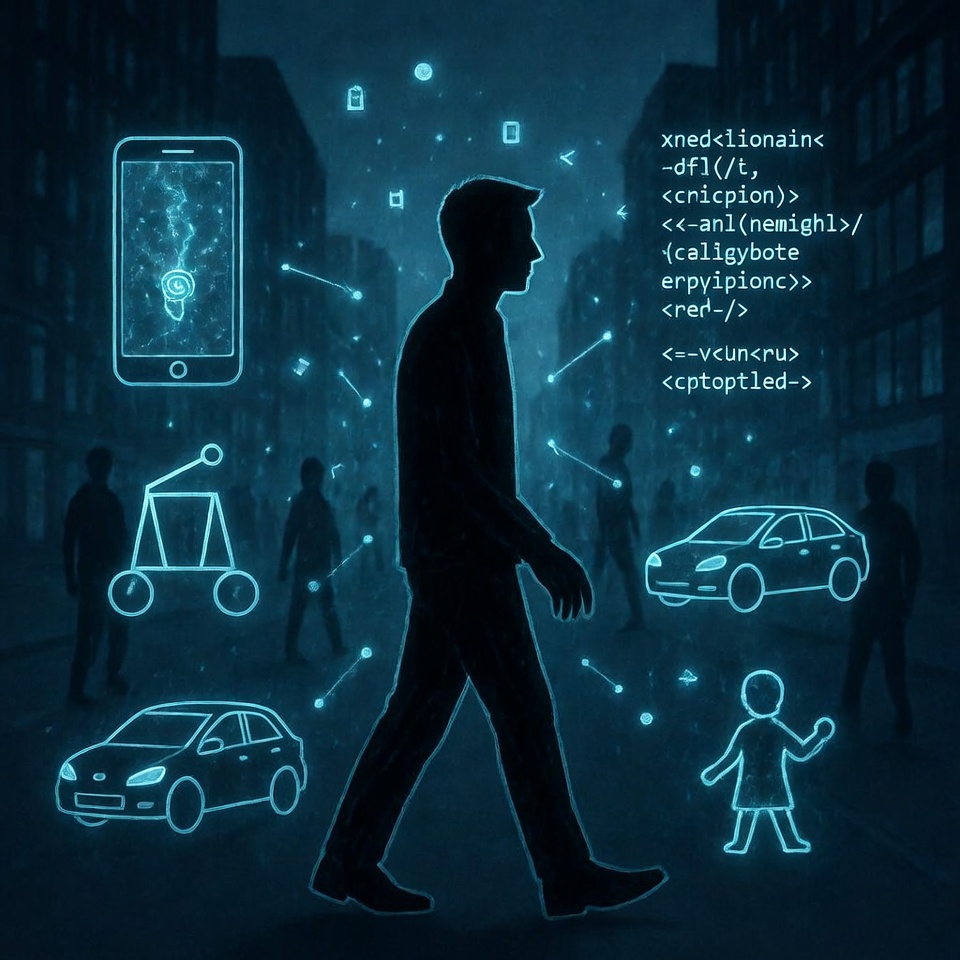

La IA invisible se ha convertido en uno de los fenómenos más relevantes del actual proceso de transformación tecnológica. Desde el primer momento plantea interrogantes jurídicos de enorme calado. No se manifiesta mediante pantallas ni interfaces claras. Opera de forma integrada en objetos, servicios y decisiones cotidianas. Por ello, su presencia pasa desapercibida para el ciudadano medio. Sin embargo, sus efectos jurídicos son reales, constantes y potencialmente lesivos.

La IA invisible

Por Javier Beltrán-Domenech. Derecho Procesal y Derecho Civil. Javier Beltrán Abogados Alicante.

A diferencia de otros avances tecnológicos, esta inteligencia no solicita consentimiento consciente. Se integra en la vida diaria y actúa de forma silenciosa. Esta circunstancia genera un serio problema de control jurídico. El Derecho se enfrenta a sistemas que influyen sin advertencia previa. Por tanto, resulta imprescindible analizar su encaje normativo desde una perspectiva estrictamente legal.

Desafío al principio de transparencia jurídica

Uno de los pilares del ordenamiento jurídico es la transparencia. El ciudadano debe conocer cuándo una decisión es automatizada. La IA invisible vulnera este principio de forma estructural. El usuario ignora que un algoritmo analiza su conducta. No existe aviso claro ni información comprensible.

Esta opacidad afecta directamente al consentimiento informado. En materia de protección de datos, el consentimiento debe ser libre y consciente. Cuando la IA invisible actúa sin que el interesado lo perciba, dicho consentimiento queda desnaturalizado. El riesgo jurídico es evidente. Se produce una recopilación masiva de datos sin percepción real del tratamiento.

Además, la falta de visibilidad impide el ejercicio efectivo de derechos. El ciudadano no puede oponerse, rectificar ni impugnar decisiones algorítmicas. Desde un punto de vista procesal, esta situación genera indefensión material.

Responsabilidad civil derivada del uso de IA invisible

La IA invisible plantea serias dudas sobre la imputación de responsabilidad. Cuando un daño se produce mediante un sistema automatizado no perceptible, ¿quién responde? El fabricante, el programador o el proveedor del servicio. El Derecho civil tradicional no fue diseñado para estas realidades.

En muchos supuestos, el perjudicado ni siquiera sabe que ha existido una intervención algorítmica. Esta ignorancia impide reclamar. La carga de la prueba se convierte en un obstáculo insalvable. Sin trazabilidad ni registros accesibles, demostrar el nexo causal resulta extremadamente complejo.

Desde esta perspectiva, la IA invisible altera el equilibrio entre las partes. El ciudadano queda en una posición de clara desventaja frente a grandes operadores tecnológicos. Esta asimetría exige una adaptación normativa urgente.

IA invisible, menores y especial protección jurídica

La utilización de IA invisible en entornos infantiles agrava el problema. Juguetes inteligentes, herramientas educativas y dispositivos de aprendizaje actúan sin interfaces visibles. El menor no distingue entre juego y control algorítmico.

El ordenamiento jurídico exige una protección reforzada del menor. Sin embargo, la IA invisible dificulta la supervisión parental y administrativa. Los datos de aprendizaje, conducta y desarrollo cognitivo son especialmente sensibles. Su tratamiento oculto puede vulnerar derechos fundamentales. Desde un punto de vista jurídico, esta situación obliga a replantear los mecanismos de autorización y control. No basta con informar de forma genérica. La invisibilidad tecnológica exige estándares más estrictos de información y supervisión.

La IA invisible y la prueba en el proceso judicial

Otro aspecto crítico es el valor probatorio de las decisiones automatizadas. La IA invisible interviene en procesos de selección, evaluación o asignación de recursos. Estas decisiones pueden tener consecuencias jurídicas relevantes.

En sede judicial, la opacidad algorítmica dificulta la contradicción. El afectado no conoce los criterios utilizados. El juez se enfrenta a sistemas cerrados, protegidos por secretos empresariales. Esta situación compromete el derecho a la tutela judicial efectiva.

La IA exige, por tanto, mecanismos legales que garanticen la explicabilidad. Sin explicación no hay defensa posible. Sin defensa, el proceso pierde legitimidad.

La necesidad de una respuesta jurídica estructural

La IA invisible no es un problema tecnológico, sino jurídico. El reto consiste en hacer visible lo que opera en silencio. El Derecho debe imponer obligaciones de identificación, información y trazabilidad. Solo así se preserva la confianza social.

La futura regulación europea avanza en esta dirección. No obstante, la aplicación práctica será decisiva. El control no puede ser meramente formal. Debe ser efectivo y comprensible para el ciudadano. En definitiva, se redefine la relación entre tecnología y Derecho. Su aceptación acrítica supone un riesgo estructural para los derechos fundamentales. Realmente, la solución no pasa por rechazar la innovación, sino por someterla a reglas claras y exigibles.

En nuestro Despacho llevamos dedicados más de 30 años a materias civiles y posiblemente podamos encontrar una solución para su caso. Pueden consultarnos pidiendo cita previa, presencial, telefónica y por videoconferencia de una o media hora en el teléfono 966171294 o enviando un mensaje al Whatsapp 628425987.

#IAinvisible #inteligenciaartificial #derechodigital #protecciondedatos #responsabilidadcivil #derechosfundamentales #algoritmos #pruebadigital #menoresytecnologia #regulacionIA

Deje su comentario